人工智能正在從文本、語音、視覺等單模態(tài)智能,向著多種模態(tài)融合的通用人工智能方向發(fā)展。“基于多模態(tài)的預(yù)訓(xùn)練大模型將成為人工智能基礎(chǔ)設(shè)施”,這一觀點已成為業(yè)內(nèi)共識。建立統(tǒng)一的、跨場景、多任務(wù)的多模態(tài)基礎(chǔ)模型正在成為人工智能研究的一個關(guān)鍵課題。未來,大模型作為基礎(chǔ)設(shè)施,將實現(xiàn)圖像、文本、音頻統(tǒng)一知識表示,并朝著能推理、能回答問題、能總結(jié)、做創(chuàng)作的認知智能方向演進。

業(yè)內(nèi)普遍認為,這得益于CLIP和BEiT-3的技術(shù)突破和廣泛應(yīng)用。

CLIP是OpenAI在2021年提出的跨模態(tài)模型,該模型專注于從文本特征映射到圖像特征。通過在互聯(lián)網(wǎng)上抓取大量圖片文本,學(xué)習一段時間過后,CLIP能夠?qū)崿F(xiàn)用自然語言解釋對圖片的理解,也能通過文字描述來生成圖片,這便是一種跨模態(tài)的生成和轉(zhuǎn)換。之后火出圈的文生圖大模型DALL-E 2,能夠通過用戶給的一段文字描述生成圖片,其背后的技術(shù)基礎(chǔ)正是CLIP模型。Stable Diffusion也使用了CLIP,實現(xiàn)通過文本提示調(diào)整模型,并借助擴散模型改善圖像質(zhì)量的目的。

圖:CLIP 流程的三個階段

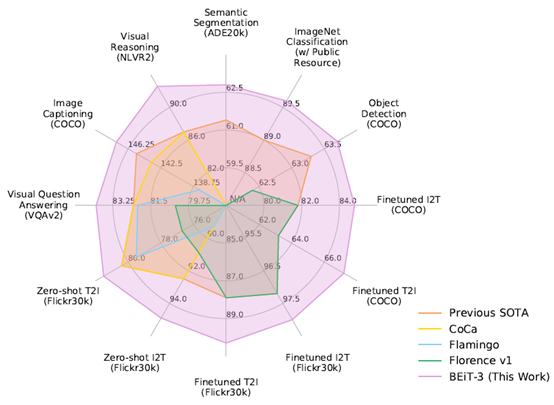

BEiT-3是微軟亞洲研究院聯(lián)合微軟圖靈團隊在2022推出的多模態(tài)基礎(chǔ)模型,該模型在視覺-語言任務(wù)處理上具備出色表現(xiàn),包括目標檢測、實例分割、語義分割、圖像分類、視覺推理、視覺問答、圖片描述生成和跨模態(tài)檢索等。BEiT-3通過統(tǒng)一的模型框架和骨干網(wǎng)絡(luò)建模,能夠更加輕松地完成多模態(tài)編碼和處理不同的下游任務(wù),為多模態(tài)研究打開了新思路。

圖:截至2022年8月,BEiT-3 在廣泛的視覺及視覺-語言任務(wù)上都實現(xiàn)了 SOTA 的遷移性能

此外,引發(fā)科技界軍備競賽的ChatGPT大家已不陌生,它是在GPT-3.5上改進得來,據(jù)最新消息,其升級版GPT-4也已推出,特點是支持多模態(tài)應(yīng)用,帶來與之前完全不同的可能性。這意味著GPT-4有可能不僅可以管理不同語言數(shù)據(jù)的輸入和輸出,也能夠做到輸出圖像甚至視頻。

科技巨頭和明星科技企業(yè)逐步強化其大模型對多模態(tài)的支持,使得外界對模型潛力的預(yù)期進一步強化,原因在于多模態(tài)感知是建立通用人工智能(AGI)的重要一步,建立多模態(tài)大模型則成為邁向通用人工智能的重要途徑,也是解決人工智能應(yīng)用落地所面臨的需求碎片化、多樣化等長尾問題的有效解決方式。

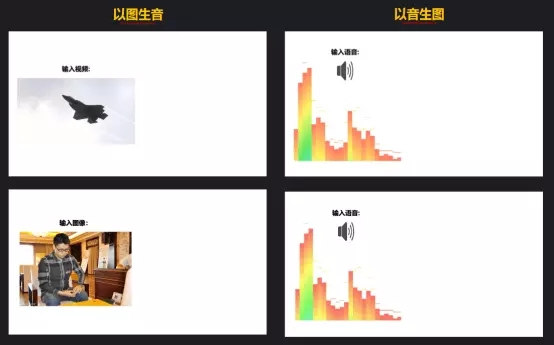

在國內(nèi),不久前,中科院自動化所宣布發(fā)布全球首個三模態(tài)大模型——紫東.太初,能夠?qū)崿F(xiàn)圖文音語義的統(tǒng)一表達,將視覺、文本、語音三種模態(tài)統(tǒng)一起來,實現(xiàn)圖文音跨模態(tài)理解與生成能力,可輕松完成以文搜圖、以圖生音、智能問答、圖片生成、視頻理解與等任務(wù),這些能力將在工業(yè)質(zhì)檢、影視創(chuàng)作、互聯(lián)網(wǎng)推薦、智能駕駛等領(lǐng)域得到應(yīng)用。

圖:紫東太初圖片、語音跨模態(tài)生成演示

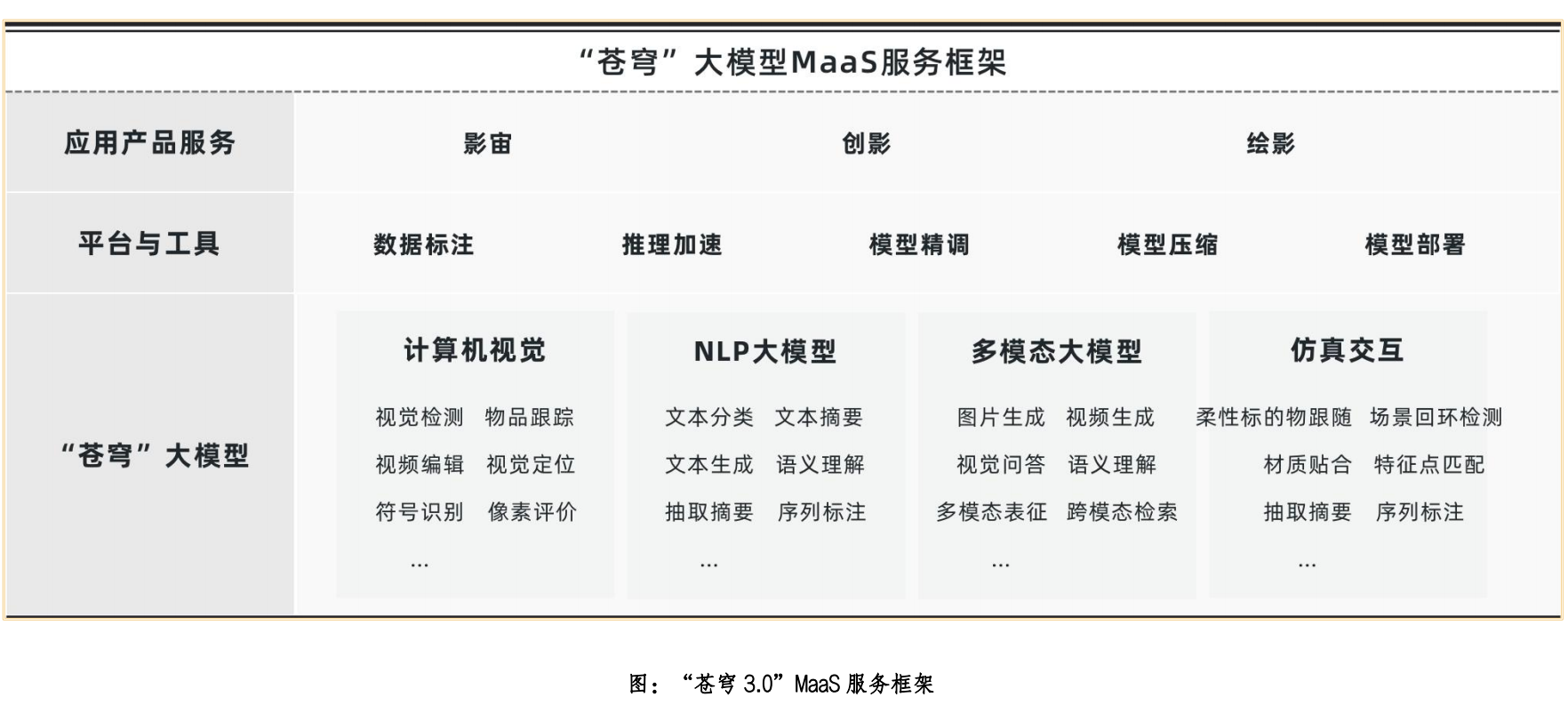

專注于智能視覺生產(chǎn)的技術(shù)企業(yè)影譜科技,近期對其多模態(tài)模型“蒼穹”進行全面升級,從早前支持“圖片-視頻”、“文本-視頻”、“語音-視頻”的基礎(chǔ)模型架構(gòu),升級為覆蓋文本、圖像、音頻、視頻、3D模型、觸覺等跨越更多模態(tài)的內(nèi)容理解和轉(zhuǎn)換生成的產(chǎn)業(yè)級大模型。據(jù)悉,升級后的“蒼穹3.0”大模型擁有豐富的視覺物料庫、高效的視覺融合能力、精準的特征提取能力、多業(yè)務(wù)場景適應(yīng)能力,在多模態(tài)預(yù)訓(xùn)練、平臺服務(wù)、落地應(yīng)用等方面實現(xiàn)突破。其圖文音視頻等多種跨模態(tài)開放任務(wù)處理能力可為元宇宙會展、智慧媒體、智慧科教、智慧文娛、數(shù)字商業(yè)等通用場景任務(wù)提供AI感知、理解和數(shù)字內(nèi)容生成能力支持,助力產(chǎn)業(yè)對其存量市場進行全面盤活,催生孵化數(shù)字新業(yè)態(tài)、新模式,實現(xiàn)提質(zhì)降本增效,同時拓展數(shù)字增量市場。

圖:影譜科技“蒼穹3.0”支持的AI作畫產(chǎn)品

事實上,在早期對于 AI 和深度學(xué)習算法的探索中,科研人員大多專注于研究單模態(tài)模型,并利用單一模態(tài)數(shù)據(jù)來訓(xùn)練模型。例如,基于文本數(shù)據(jù)訓(xùn)練自然語言處理(NLP)模型,基于圖像數(shù)據(jù)訓(xùn)練計算機視覺 (CV) 模型,使用音頻數(shù)據(jù)訓(xùn)練語音模型等等。然而,在現(xiàn)實世界中,文本、圖像、語音、視頻等形式很多情況下都不是獨立存在的,而是以更復(fù)雜的方式融合呈現(xiàn),因此在人工智能的探索中,跨模態(tài)、多模態(tài)也成了近幾年業(yè)界研究的重點。

業(yè)內(nèi)人士分析稱,多模態(tài)預(yù)訓(xùn)練模型集成語音、文本、圖像、視頻等各個模態(tài)信息的處理模式,更加貼近人類感知,也具有更高的社會價值和商業(yè)前景。

多模態(tài)預(yù)訓(xùn)練模型的發(fā)展將重塑人工智能商業(yè)模式,并為人們的生產(chǎn)生活方式帶來積極影響。對個人而言,類似CLIP的多模態(tài)模型,將使更多非技術(shù)出身的人能夠表達自己的創(chuàng)造力,無需再借助工具和編程專業(yè)能力。對企業(yè)來說,多模態(tài)預(yù)訓(xùn)練模型將成為企業(yè)生產(chǎn)效率提升的關(guān)鍵。商業(yè)模式上,具備大數(shù)據(jù)、算力資源和模型開發(fā)能力的科技企業(yè),將會成為模型服務(wù)的提供方,幫助企業(yè)將基礎(chǔ)模型的能力與生產(chǎn)流程融合起來,實現(xiàn)效率和成本最優(yōu)。