當?shù)貢r間4月18日晚間,Meta終于正式發(fā)布全新一代開源模型Llama3。

作為一款備受矚目的大型模型,Llama3的發(fā)布立刻在全球范圍內(nèi)引起了廣泛的關注和討論。Llama3目前已經(jīng)登陸其官方網(wǎng)站和知名平臺Hugging Face,成為了人工智能領域的一大焦點。值得一提的是,盡管商業(yè)使用受到一定條件的限制(月活躍用戶不得超過7億),但基本上仍然可以算作是免費商用。

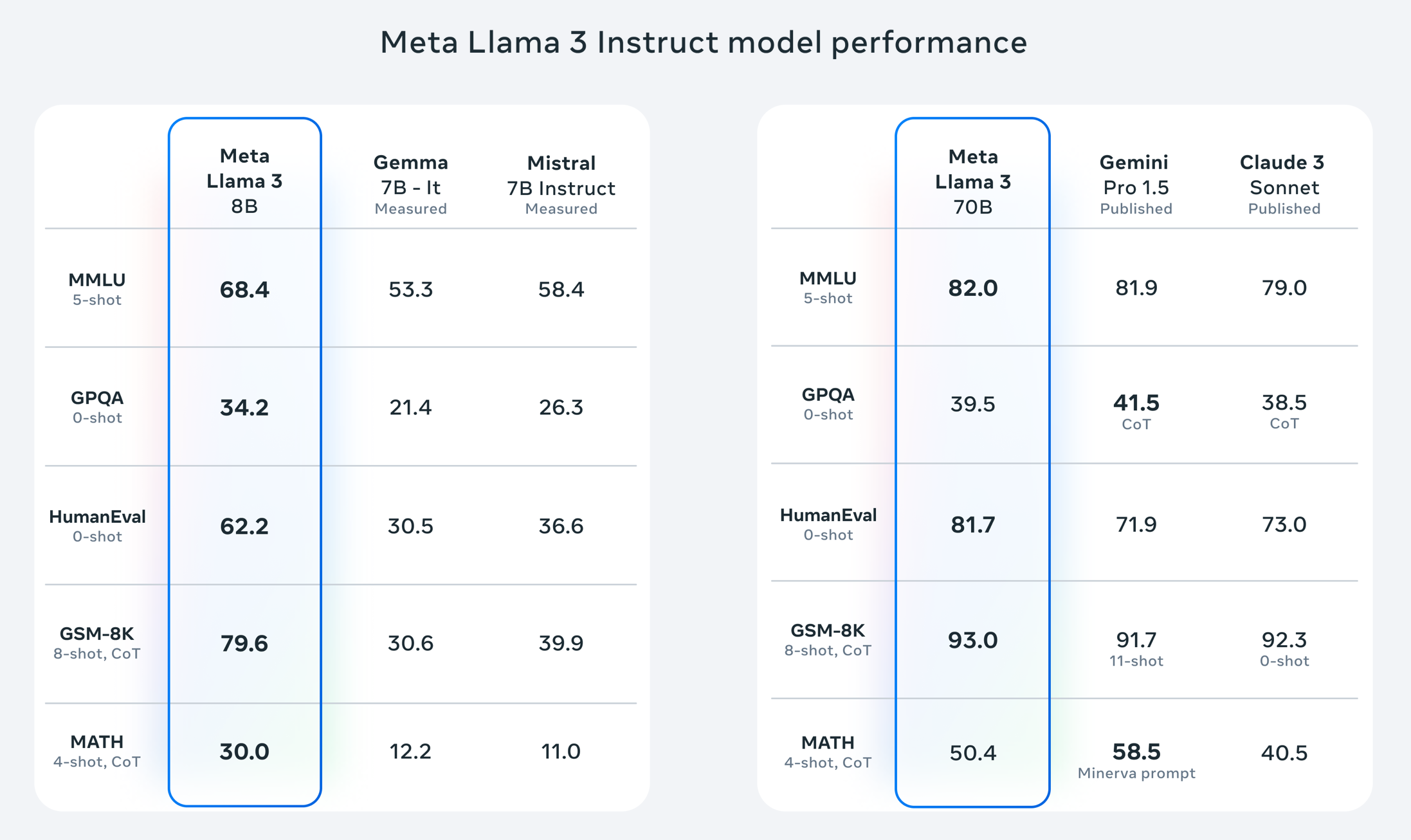

大模型了解到,這次發(fā)布的Llama3涵蓋了兩個版本,即8B和70B,為各種廣泛應用提供了強大的支持。按照Meta的說法,Llama 3 8B和Llama 3 70B是目前同體量下,性能最好的開源模型。Llama 3 8B在某些測試集上性能比llama 2 70B還要強。這些版本提供了預訓練和指令調優(yōu)版本,可直接在Meta AI中體驗。Meta AI是一個智能助手,改變了人們與人工智能交互的方式,擴展了任務完成、創(chuàng)造和連接的可能性。開發(fā)代理和其他人工智能應用程序的開發(fā)者將受益于Llama 3的8B和70B版本,這些版本為他們提供了所需的靈活性和性能。

Llama 3的性能令人印象深刻,特別是在語言理解、上下文理解以及諸如翻譯和對話生成等復雜任務方面。其具有強大的可擴展性和性能,可以輕松處理多步任務。通過精心優(yōu)化的后訓練過程,大大降低了虛假拒絕率,提高了響應對齊度,并增加了模型答案的多樣性。此外,Llama 3還顯著提高了推理、代碼生成和指令跟蹤等能力。

同時,Llama3的性能也經(jīng)受起了時間的考驗,得到了廣泛的認可。在一系列評測中,無論是在學科知識理解、一般問題、代碼能力、數(shù)學能力還是其他領域,Llama3都表現(xiàn)出色。甚至在與其他領先模型的比較中,Llama3也取得了巨大成功,凸顯了其在開源模型中的卓越地位。

Meta官方宣稱,Llama 3模型的發(fā)布將數(shù)據(jù)擴展到了新的高度。它是在最近宣布的兩個定制的24K GPU集群上進行訓練的,使用了超過15T令牌的數(shù)據(jù),這個訓練數(shù)據(jù)集比Llama 2使用的大7倍,其中包括4倍的代碼。

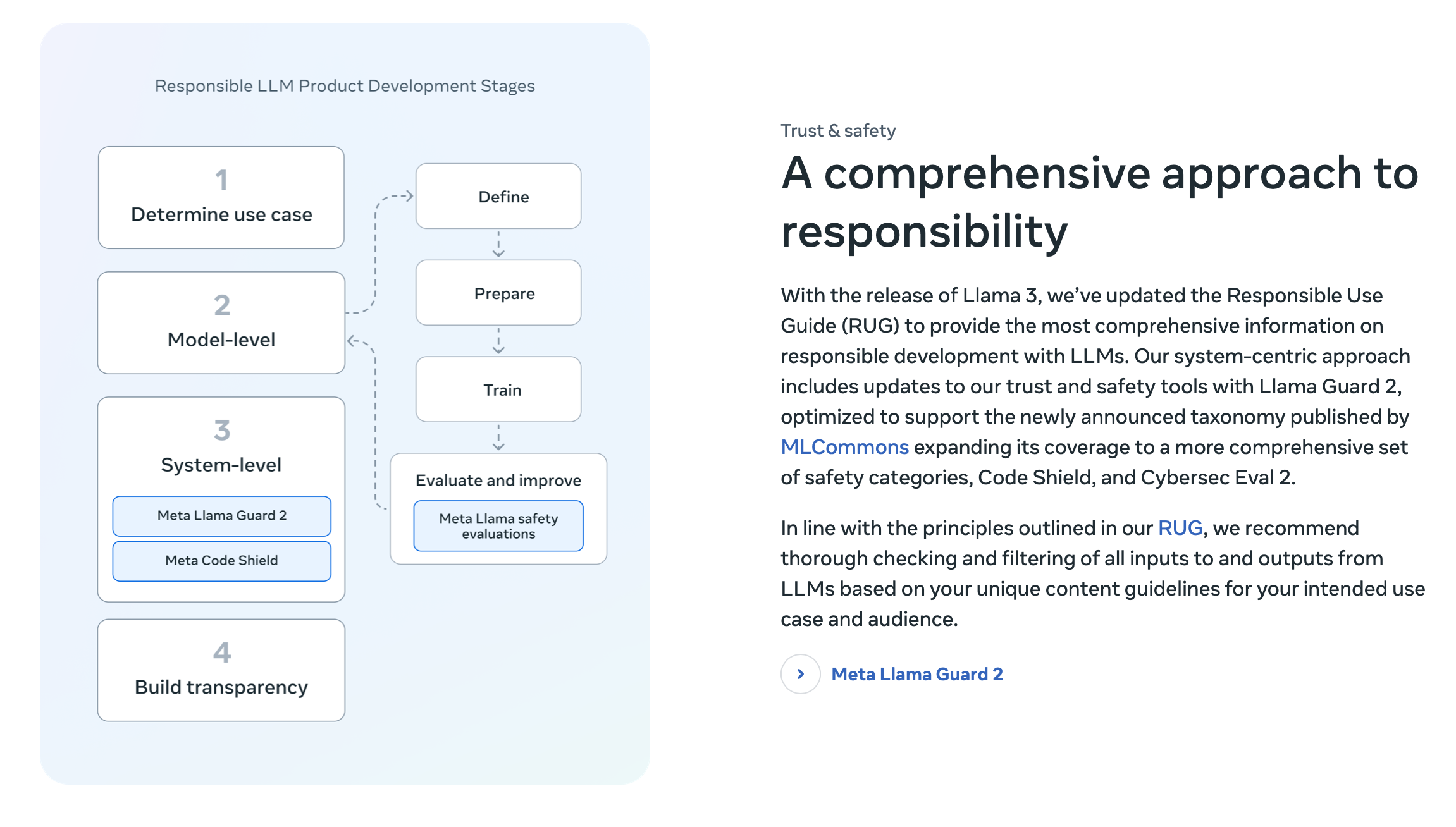

隨著Llama 3的發(fā)布,相應的《負責任使用指南》也得到了更新,提供了與LLM負責任開發(fā)相關的最全面信息。更新的系統(tǒng)方法包括更新的信任和安全工具,其中包括優(yōu)化后的Llama Guard 2,以支持MLCommons發(fā)布的新公布的分類法,將其覆蓋范圍擴展到更全面的安全類別,包括代碼防護和網(wǎng)絡安全評估。

此外,Llama3發(fā)布團隊還進行了一項有趣的測試,評估了模型在一系列關鍵用例中的表現(xiàn)。為了防止過擬合,測試團隊在建模過程中對類別和提示進行了人工評估,其結果證明了Llama3的強大性能和多樣化應用的潛力。

然而,盡管Llama3在各方面都表現(xiàn)出色,但也存在一些挑戰(zhàn)。例如,知識庫時間和上下文長度等方面仍有待提高,雖然使其容量加倍,但其上下文長度僅支持到8K,同時在面對一些特定的難題時,Llama3仍然有進一步優(yōu)化的空間。

眾所周知,國內(nèi)外有大量的大模型都源自開源大模型,尤其是建立在Llama上而來,因此Llama3的發(fā)布,對于大模型創(chuàng)企而言同樣意義重大。這一開源之舉不僅為開發(fā)者和研究人員提供了更多的技術選擇和資源支持,而且為人工智能技術的全球推廣和普及貢獻了巨大的力量。

Llama3的開源意味著創(chuàng)新的可能性被無限放大,不再受限于少數(shù)專業(yè)機構或大企業(yè)的封閉研發(fā),而是讓更多的人能夠參與到人工智能技術的創(chuàng)造和應用中來。這對于促進人工智能技術的全球共享和發(fā)展,推動行業(yè)技術進步和創(chuàng)新都具有重要的意義。

部分云計算企業(yè)也宣布將在第一時間為客戶提供該模型,例如,亞馬遜云科技表示將為客戶提供了該模型,客戶可以通過Amazon SageMaker Jumpstart來發(fā)現(xiàn)和部署Llama 3模型,并運行推理。

在大模型之家看來,Llama3的發(fā)布標志著開源模型邁向新的里程碑,為人工智能領域帶來了巨大的推動力。其強大的性能和全面的應用支持使其成為開發(fā)者和研究人員的首選,為人工智能的未來奠定了堅實的基礎。