年初,OpenAI發(fā)布名為“Sora”的視頻大模型,引爆全球。

與去年ChatGPT爆火帶來的文本生成相同,今年Sora的出現(xiàn),讓全球再次看到了AIGC的巨大威力。從1月底的萬興“天幕”大模型再到Sora,大模型正在從圖文1.0時代,加速進入到以音視頻多媒體為載體的2.0時代。

Sora的強勢表現(xiàn),掀起了行業(yè)熱議。這廂谷歌用自家AI新品“打假”Sora,那邊特斯拉CEO馬斯克則直接表示人類愿賭服輸(gg humans),更有不少專業(yè)人士直接對Sora的技術(shù)報告“開挖”。

眾說紛紜下,不可否認的是,Sora確實帶來了視頻生成的全新可能性與震撼感。業(yè)界不乏有人用“史詩級”、“現(xiàn)實不存在了”等來形容Sora的“炸裂”,并總結(jié)出以下五大提升之處:

1.一鍵生成60秒視頻:只需一段文本,Sora就可以生成長達60秒的視頻。

2.復(fù)雜場景和角色生成能力:Sora生成的視頻在內(nèi)容豐富度、質(zhì)量精美度、鏡頭多樣度等方面有質(zhì)的飛躍。

3.多鏡頭生成能力:Sora可以在單個生成的視頻中創(chuàng)建多個鏡頭,同時保持角色和視覺風(fēng)格的一致性。

4.三維空間的連貫性和物體持久性Sora能夠生成具有動態(tài)相機運動的視頻。在相機移動和旋轉(zhuǎn)時,Sora能夠保持人物和場景元素的連貫運動,并確保在整個視頻中物體的外觀一致。

5.與世界的互動:Sora有時能模擬出簡單的物理行為。例如,畫家在畫布上留下筆觸,或者某人吃漢堡留下咬痕。

“炸裂”表現(xiàn)只是表象,透過OpenAI發(fā)布的技術(shù)報告,以下三大特點或許是Sora出圈的關(guān)鍵:

大力出奇跡

眾所周知,去年引發(fā)第一波AI浪潮的ChatGPT,是OpenAI“大力出奇跡”的范式。大量數(shù)據(jù)的訓(xùn)練會讓大模型產(chǎn)生“涌現(xiàn)”的能力,這讓ChatGPT能夠擁有更好的語言表達能力以及邏輯能力。

這次Sora顯然是另一個“大力出奇跡”的范本。據(jù)相關(guān)人士推測,此次Sora的訓(xùn)練參數(shù)量約30億。這個數(shù)字看似與GPT-4的1.8萬億相差甚遠,但對于視頻類模型訓(xùn)練來說,Sora已經(jīng)是名副其實的“大”模型。

相比起“隨處可得”的文本數(shù)據(jù),原始視頻的數(shù)據(jù)量就已“輸在起跑線上”,更不用說在Sora之前,大部分模型都需要將原始視頻進行統(tǒng)一格式的裁剪,以便于訓(xùn)練。

視頻數(shù)據(jù)有各種各樣的形式,有橫屏的,有豎屏的,有4k高清的電影,也有64*64的馬賽克圖片。統(tǒng)一格式,意味著很多非目標格式的視頻,都會面臨大多數(shù)畫面被浪費的窘境。

為了解決各類視頻分辨率、格式不一,難以統(tǒng)一進行學(xué)習(xí)的問題,OpenAI設(shè)計了一種叫做“spacetime patches”的分解方式,將視頻分解成統(tǒng)一格式的小模塊,以最大化利用所有視頻數(shù)據(jù)。

Spacetime patches究竟是什么呢?我們可以從patch入手來理解。

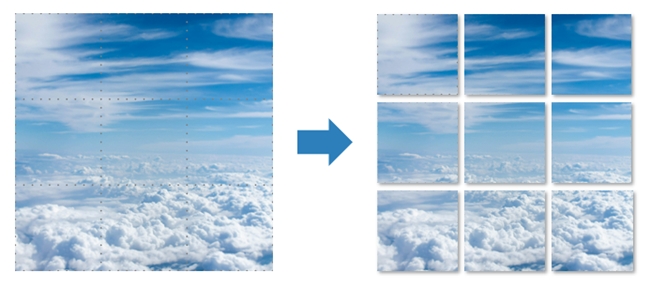

Patch可以理解為一張圖片的其中一小塊截圖。假設(shè)現(xiàn)在有一張9×9分辨率的圖片,設(shè)定每一個patch是一個3×3分辨率的小碎片,那么這張圖片就可以被分割成為9個patches,他們各自相鄰,組合在一起就能夠復(fù)原出一張完整的圖片。

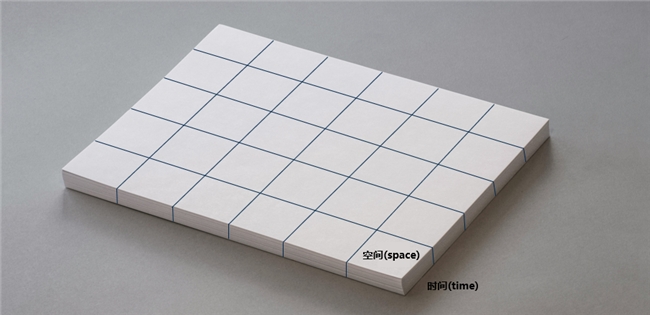

而spacetime patches,則是將一個視頻按照這個原理進行分割。眾所周知,視頻本質(zhì)上是隨時間變化的一系列圖像(也就是幀)。如果將視頻中每一幀都看做一頁A4紙,那么隨著時間軸的不斷推進,可以分解出很多很多頁“紙”。將這些“紙”按照順序摞在一起,這摞“紙”就有了一定的高度,而這個“高度”實際上就是時間軸。

現(xiàn)在,如果想要將視頻也分解成一個個patch,其實類似于直接將這摞“紙”按照一定規(guī)格大小切開——我們就得到了一小摞一小摞的“紙”。每一小摞“紙”的“高度”依舊是視頻的時間軸,而每一頁則是每一幀畫面中的一小部分。

由此,這些小紙堆既包含了每一幀畫面中的一部分信息,還包含了這個固定位置的畫面如何隨著時間流逝而產(chǎn)生變化的信息。這就是spacetime patches,它們代表了視頻數(shù)據(jù)的兩個最重要的維度——空間和時間。

通過采用spacetime patches的模式來對視頻進行最大程度的分解與訓(xùn)練,Sora為行業(yè)提供了一個將視頻數(shù)據(jù)“物盡其用”的方法,對于數(shù)據(jù)需求量巨大的視頻生成行業(yè)來說,這顯然是個好消息。

現(xiàn)在,萬事俱備,只待訓(xùn)練了。

特集眾家之“大成”

剛才介紹了OpenAI如何把完整的一個視頻,遵循一定邏輯轉(zhuǎn)化成能夠投入訓(xùn)練的“原材料”。那么,原料已備齊,這次的“廚師”又有什么過人之處呢?

與市面上大部分視頻生成類大模型不同,Sora采用了一個比較特別的“廚師”——Diffusion Transformer(DiT)模型。

DiT結(jié)合了Diffusion(擴散模型)和Transformer兩大目前AI行業(yè)最火模型的原理結(jié)構(gòu),集兩者之大成,真正讓Sora生成的視頻能夠流暢。

其中,Diffusion是目前市面上最主流的圖片生成模型,通過對輸入的圖片打上噪點(可以理解為一種馬賽克),再根據(jù)全是噪點的圖片來反推原圖,來學(xué)習(xí)圖片生成。

Diffusion在生成單張圖片時效果還是很不錯的。但問題在于,對于視頻生成領(lǐng)域來說,算法需要生成連續(xù)數(shù)幀圖像、保障每一幀圖像都能夠與前后幀絲滑地連續(xù)變化,同時整體的變化過程還需要符合邏輯。

如果單純使用Diffusion來生成視頻,那么隨著視頻時間變長,算法無法保障當前畫面和5秒、10秒以后的畫面是否還能夠符合變化邏輯。

為了解決這一問題,OpenAI引入了Transformer來增強算法對于生成內(nèi)容的整體掌控能力。

作為GPT系列的底層模型,Transformer在提升內(nèi)容整體的完整度上有自己的獨門絕技——那就是它的自注意力機制。自注意力機制能夠讓大模型在訓(xùn)練的時候,不僅學(xué)習(xí)當下這個單詞的編碼,更能夠同時學(xué)習(xí)到這個單詞周圍的其他單詞、它們之間是什么關(guān)系。

在NLP里,自注意力機制能夠讓GPT學(xué)會每一個單詞和周圍單詞之間的關(guān)系、更深層次地理解了一個句子的構(gòu)成邏輯。

放在視頻生成中,Transformer的自注意力機制則能夠幫助機器學(xué)習(xí)到每一個patch之間的關(guān)系——不論是空間上的,還是時間上的關(guān)系。正如GPT理解了句子的構(gòu)成邏輯一樣,Sora也理解了一個畫面隨著時間流逝而變化的邏輯。

由此,一個能夠讓生成的視頻內(nèi)容更穩(wěn)定、更符合現(xiàn)實邏輯的視頻生成算法就煉成了,而DiT在Sora中的優(yōu)越表現(xiàn),也為行業(yè)帶來了“另辟蹊徑”的解題思路。

讓大模型更能“聽得懂話”

除了圖像/視頻的數(shù)據(jù)處理與訓(xùn)練,語言理解仍然是用戶與大模型交互的最主要途徑。這意味著,Sora不僅需要會生成視頻,還需要會根據(jù)文字指令來生成符合要求的視頻。

OpenAI又是怎么讓Sora能夠更好理解文字指令的呢?

OpenAI采用了此前已在DALL·E 3中使用的re-captioning技術(shù),通過訓(xùn)練一個用于詳細描述視頻內(nèi)容的文本模型,來對所有投入訓(xùn)練的視頻素材進行詳細的文字描述。

這個專門的文本模型會對包括視頻的主要內(nèi)容、角色運動、鏡頭運動、環(huán)境、背景、細節(jié)、風(fēng)格等等內(nèi)容進行總結(jié)。通過模板化的方式進行系統(tǒng)的描述,Sora可以清晰地了解到每段視頻的具體內(nèi)容。

這部分文本描述內(nèi)容可以在最終訓(xùn)練的時候與前面提到的時空圖像塊進行匹配和訓(xùn)練。最終,AI就可以理解和對應(yīng)上文本描述與視頻時空圖像塊。

此外,OpenAI還使用了GPT,把用戶的簡短提示詞轉(zhuǎn)化成詳盡的說明,生成更便于Sora理解的prompt。也就是說,用戶的簡單的描述會被轉(zhuǎn)化為與訓(xùn)練時類似的詳細描述語句。這有助于Sora準確理解用戶的需求。

視頻行業(yè)迎來新春天

Sora的橫空出世,顯然將會給視頻領(lǐng)域帶來諸多變化,也將為所有做視頻模型的企業(yè)指出優(yōu)化路徑,加速提升大模型在視頻創(chuàng)作和視頻創(chuàng)意生成方面的賦能能力,并擴展“音視頻+大模型”的應(yīng)用空間。

正如AIGC軟件A股上市公司萬興科技(300624.SZ)董事長吳太兵此前指出的,大模型正從圖文1.0時代,加速進入到以音視頻多媒體為載體的2.0時代,從模型到應(yīng)用場景對用戶一條龍賦能,將成為主流發(fā)展趨勢。

當前,包括萬興科技在內(nèi)的公司,都在積極布局大模型。年初,萬興科技推出萬興“天幕”音視頻大模型,聚焦數(shù)字創(chuàng)意垂類創(chuàng)作場景,基于15億用戶行為及100億本土化高質(zhì)量音視頻數(shù)據(jù)沉淀,以音視頻生成式AI技術(shù)為基礎(chǔ),全鏈條賦能全球創(chuàng)作者,致力于讓大模型應(yīng)用落地更有針對性、更具實效。

目前,萬興“天幕”眾多能力已在萬興科技旗下創(chuàng)意軟件產(chǎn)品中規(guī)模化商用。其中,視頻創(chuàng)意產(chǎn)品Wondershare Filmora 13、一站式出海視頻營銷神器萬興播爆均已實現(xiàn)大模型能力的落地應(yīng)用。

依托萬興“天幕”大模型能力,萬興科技正加速重塑“創(chuàng)意軟件”,推動旗下產(chǎn)品全面智能化,不斷降低大模型使用門檻,讓大模型更好地賦能全球新生代創(chuàng)作者。